„Wahrnehmung, Entscheidungsfindung und Ausführung“ Unter den drei Hauptelementen des autonomen Fahrens ist „Wahrnehmung“ zweifellos das wichtigste.

Wenn ein autonomes Fahrzeug den Fahrer ersetzen will, um die Bedienung des Fahrzeugs zu übernehmen, muss es eine stärkere Wahrnehmung als der Mensch haben. Wenn eine genaue Wahrnehmung nicht erreicht werden kann, sind Entscheidungsfindung und Ausführung unmöglich. Die Realisierung einer sicheren, zuverlässigen und genauen Wahrnehmung kann nicht allein durch ein einzelnes Produkt oder eine einzelne Technologie erreicht werden.

In diesem Stadium werden L3-Autopilotmodelle in Massenproduktion hergestellt und zum Verkauf angeboten, was wirklich die Tür zu High-End-Autopiloten öffnet. Ob Automobilunternehmen, Sensorhersteller oder Technologiegiganten, sie alle glauben, dass sie nur durch die Anwendung der Sensorfusion die Wahrnehmungsanforderungen von autonomen High-End-Fahrzeugen erfüllen können.

Heute nimmt Xiaohui alle mit, um einen Blick darauf zu werfen, welche Sensorfusionslösung die beste Wahl für autonomes Fahren ist!

Um eine genaue Wahrnehmung zu erreichen, können Sie sich nicht auf "Einzelkampf" verlassen.

Die Bedeutung von Sensoren für selbstfahrende Autos muss nicht wiederholt werden. Unter den drei Hauptelementen des autonomen Fahrens ist die Wahrnehmung die Grundlage für die Entscheidungsfindung und -ausführung, und sie ist auch das kritischste Puzzleteil im Prozess des autonomen Fahrens im vollen Sinne der Verwirklichung.

Die Realisierung einer sicheren, zuverlässigen und genauen Wahrnehmung kann jedoch nicht allein durch einen bestimmten Sensortyp erreicht werden. Da das sogenannte „Manchmal kann sich ein Fuß als kurz erweisen, während sich ein Zoll als lang herausstellen kann“, sind die aktuellen Mainstream-Sensoren nicht die „sechseckigen Krieger“, die vollständig in der Lage sind, autonome Fahrzeugerfassungsaufgaben allein zu bewältigen.

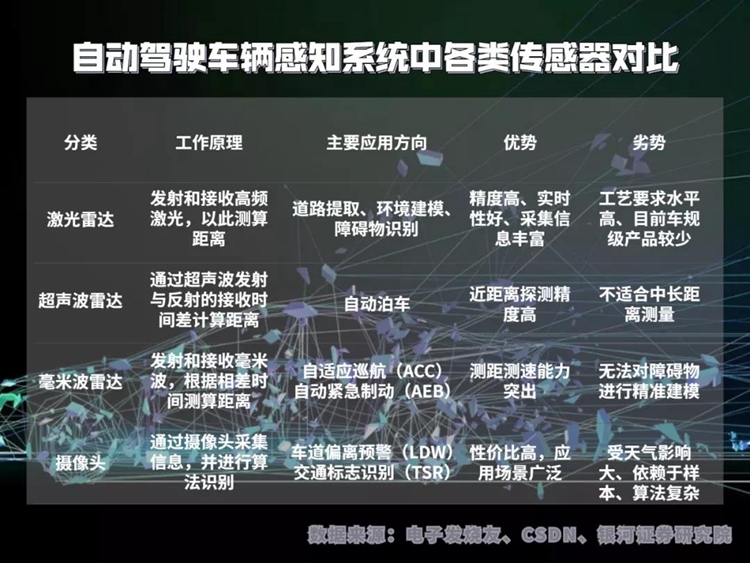

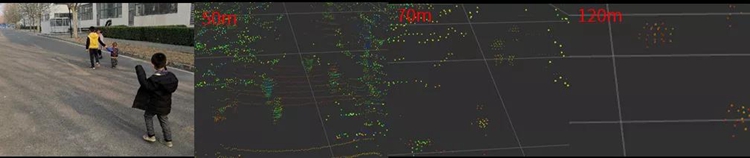

Lidarhat herausragende Vorteile wie hohe Genauigkeit, Langstreckenmessung, gute Echtzeitleistung und reichhaltige Sammlung von Informationen. In den letzten Jahren hat es auch große Fortschritte in den Bereichen Kabelbaum, Miniaturisierung, Einhaltung von Fahrzeugvorschriften und Kostenkontrolle gemacht. Bei der Erkennung entfernter Objekte sind die von Lidar erhaltenen Positionsinformationen jedoch oft spärlich. Sich auf den Unterschied des Reflexionsvermögens von Hochfrequenzlasern zu verlassen, um Hindernisse von Materialien zu unterscheiden, ist in der komplexen realen Fahrumgebung etwas unzureichend.

Die Millimeterwellenradartechnologie ist ausgereift, aber da die Millimeterwelle erheblich durch die Dämpfung und Absorption der Atmosphäre beeinflusst wird, ist das Millimeterwellenradar nicht in der Lage, eine genaue und kontinuierliche Modellierung von Hindernissen im dynamischen Prozess des Fahrzeugfahrens durchzuführen.

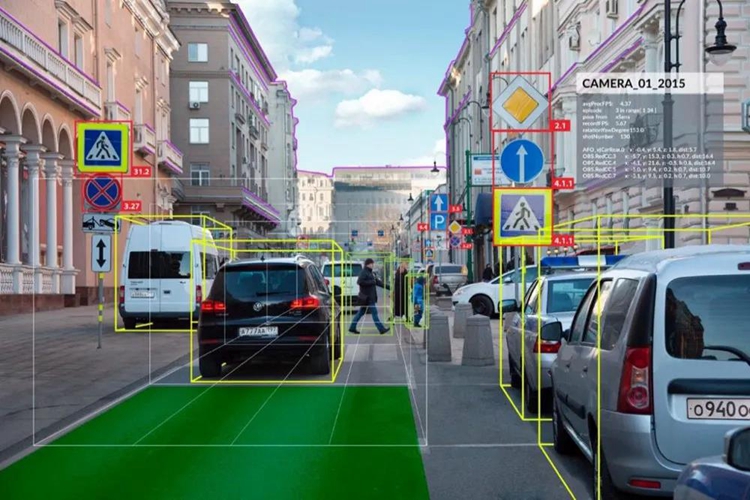

Die Kameratechnik ist zwar ebenfalls sehr ausgereift und hochauflösend, hat aber ein eingeschränktes Sichtfeld und kann nur auf ein begrenztes Sichtfeld fokussieren. Darüber hinaus sind die erhaltenen Daten oder Bilder zweidimensional, ohne Tiefenwertinformationen, und können den relativen Abstand verschiedener Objekte innerhalb des Erfassungsbereichs nicht genau wiedergeben.

Die Kamera kann nur auf ein begrenztes Sichtfeld fokussieren

Die Genauigkeit der Ultraschallradarerkennung ist extrem hoch, die Erkennungsentfernung ist sehr kurz und die Übertragung und der Empfang von Ultraschallwellen sind anfälliger für Wetterbedingungen als Millimeterwellen. In einer Hochgeschwindigkeitsumgebung erhöht sich der Ultraschallentfernungsfehler aufgrund der niedrigen Geschwindigkeit des Detektionsmediums.

Zwar gibt es auch „Fundamentalisten“ wie Tesla, die immer an der Linie der reinen visuellen Wahrnehmung festhalten. Aber insgesamt sind Lösungen, die verschiedene Arten von Sensoren integrieren, in der Branche des autonomen Fahrens am beliebtesten.

Die "Standardantwort" für Sensorfusion

Allerdings ist es auch recht schwierig, Fusionsanwendungen für verschiedene Arten von Sensoren zu implementieren. Einige Sensoren sind von Natur aus schwierig zu fusionieren, und einige Fusionen zwischen Sensoren sind nicht lohnenswert.

Zum Beispiel zwischen Lidar- und Ultraschallsensoren und Millimeterwellenradaren, obwohl sie unterschiedliche Medien erkennen, sind ihre Arbeitsprinzipien ähnlich, und Lidar ist den beiden anderen Sensoren in Bezug auf die Erkennungsleistung weit überlegen.

Nehmen Sie C-Fans-256, das weltweit erste 256-zeilige Solid-State-Lidar mit Autospur, das offiziell von freigegeben wurdeSurestarvor nicht allzu langer Zeit: Die Produkte der C-Fans-Serie sind die ersten heimischen Front-Lidars mit kompletter PKW-Ausführung als Serie. Das neueste Produkt in China, C-Fans-256, hat eine Auflösung von 0,1°x0,1°. Mit seinem omnidirektionalen Scan-Sichtfeld kann es problemlos eine großflächige und weiträumige Bereichsüberwachung realisieren und autonome Fahrzeuge wie das Linksabbiegen ohne Schutz bieten ein breites Sichtfeld in schwierigen Szenen, um sich um Fahrzeuge zu kümmern oder Fußgänger auf der rechten Seite.

Der weltweit erste 256-StrahlSolid-State-Lidar C-Fans-256 in Automobilqualität

Die ultrahohe Bildrate der Sportkameraebene verleiht diesem Lidar ein starkes Sichtfeld und die Fähigkeit, anormale Ereignisse zu erfassen, sei es das Erkennen von Hindernissen oder Geistersonden, das Hochgeschwindigkeits-Einfädeln in die Hauptstraße oder das Hochgeschwindigkeits-Plötzchen Bremsen und automatisches Fahren schwierige Szenen. Es hat eine gute Leistung darunter, die besser für schnelle, dynamische und komplexe reale Fahrumgebungen geeignet ist. Mit einer 8-Bit-Graustufenauflösung realisiert C-Fans-256 eine Allwetter- und klare Spurlinienerkennung.

Gegenwärtig ist das weiterentwickelte Lidar mit seiner umfassenden und herausragenden Leistung weithin als der wichtigste Sensor für das autonome Fahren anerkannt. Wenn die drei miteinander verschmolzen werden, lautet das Ergebnis wahrscheinlich "1 + 1 + 1 = 1", was die Vorteile von Ultraschallsensoren und Millimeterwellenradaren nicht widerspiegeln kann.

Obwohl das Millimeterwellenradar das Problem effektiv kompensieren kann, dass die von der Kamera gesammelten Originaldaten keine Tiefenwertinformationen enthalten, ist die Zielauflösung des Millimeterwellenradars sehr gering, und die Größe und Kontur des Ziels können nicht einmal bestimmt werden in einigen Szenarien. Siehe "Frage". Dies macht es unmöglich, eine Integration auf niedriger Ebene und in die Tiefe zwischen den beiden zu erreichen, und häufiger können sie nur in Form einer "vereinfachten Integration" verwendet werden, um einige Probleme mit der Zielgeschwindigkeitsmessung oder der Trajektorienverfolgung zu lösen.

Unabhängig davon, ob es sich um die überwiegende Mehrheit der derzeit auf dem Markt befindlichen L3-Autopilotmodelle oder um die veröffentlichten übergeordneten Autopilotlösungen handelt, haben sie sich für eine Wahrnehmungslösung entschieden, die auf "Lidar + Kamera“ und unterstützt von weiteren Umgebungssensoren.

Ein aktuelles Mainstream-Fusionsschema „Lidar + Kamera“.

Warum konzentrieren sich alle Arten von Sensoren, ob Autohersteller oder Technologiegiganten, alle auf Lidar und Kameras?

Im Allgemeinen liegt es daran, dass sich beide gut integrieren lassen, um das ultimative Ziel zu erreichen, „von den Stärken des anderen zu lernen“, damit das autonome Fahrsystem tatsächlich die „langen“ nehmen und alle „Shorts“ ausgleichen kann. Es kann als „Standardantwort“ für die Sensorfusion in autonomen Fahrwahrnehmungssystemen bezeichnet werden.

Lidar + Kamera = Zukunft

Lidar wird von der Industrie als „Auge des autonomen Fahrens“ gefeiert. Allein in Bezug auf die Wahrnehmungsleistung ist er der beste Sensor aller Art, den ein autonomes Fahrsystem benötigt. Das Lidar sendet und empfängt Hochfrequenzlaser, um Positionsinformationen zu erhalten, wodurch es eine extrem hohe Entfernungsgenauigkeit und Widerstandsfähigkeit gegenüber Umwelteinflüssen erreichen kann. Im Vergleich zu anderen 3D-Sensoren hat die Reichweite von Lidar offensichtliche Vorteile.

Lidar verfügt über hervorragende Sensorfähigkeiten

Das ultrahochauflösende Festkörper-Lidar C-Fans-256 auf Bildebene, entwickelt vonSurestarkann die Positions- und Punktinformationen von Fahrzeugen und Fußgängern in einer Entfernung von 200 m genau erfassen und Würfelhindernisse mit einer Seitenlänge von 20 cm genau identifizieren. Die effektive Entfernung beträgt ebenfalls bis zu 60 m.

C-Fans-256 erreicht auch einen Stromverbrauch von weniger als 16 W und hat eine hohe Fahrzeugkonformität mit insgesamt 31 Tests in 9 Kategorien von ISO16750 und kann in rauen Umgebungen wie starker Kälte und Hitze stabil und normal arbeiten, hoch Temperatur und Luftfeuchtigkeit, starke Stöße usw. . Darüber hinaus ist ein weiteres Produkt derselben Serie, C-Fans-32, derzeit das einzige Lidar-Produkt, das die Zertifizierung „Eigensicherheit“ bestanden hat.

Als Bildsensor, den es schon lange gibt, hat die Kamera relativ geringe Kosten. Nicht nur die dazugehörige Industriekette, sondern auch die Kamera ist technisch sehr ausgereift. Darüber hinaus hat die Kamera eine hohe Auflösung, und die dichte Schätzung der Tiefeninformationen auf große Entfernung kann durch Algorithmusverarbeitung erhalten werden.

Anwendung der Kamera im fahrerlosen Auto

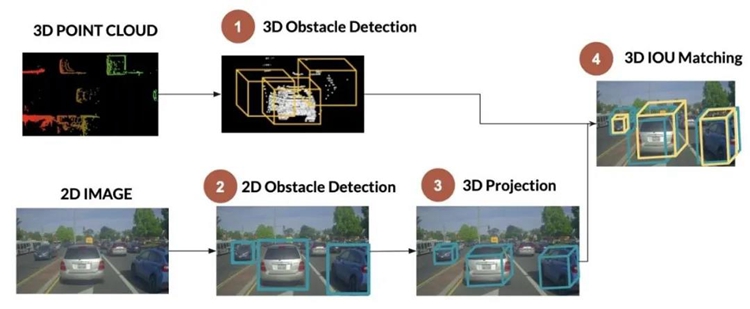

Unter der Prämisse, die Kalibrierung und Synchronisierung des Lidars und der Kamera abzuschließen, kann die Punktwolke des Lidars kalibriert und auf die Bildebene der Kamera projiziert werden, um eine relativ spärliche, aber sehr genaue Tiefenkarte zu bilden. In Kombination mit den Verarbeitungsergebnissen des Bildalgorithmus ist es dem autonomen Fahrwahrnehmungssystem möglich, genaue und dichte Tiefeninformationsdaten fast ohne Sackgassen zu erhalten, um die relative Entfernung, das Positionsprofil und die Bewegungsgeschwindigkeit von Hindernissen genau zu erfassen in einem großen Erfassungsbereich.

Für Lidar kann die Kamera nicht nur den Einfluss der etwas spärlichen lokalen Punktwolke bei der Erkennung von Fernzielen glätten, sondern auch die Auflösung verschiedener Hindernisse mit demselben Material und ähnlichen Positionen durch die hochauflösende Realszene der Kamera verbessern Bild.

Die Existenz von Lidar verbessert das Problem der geringen Genauigkeit der Tiefenschätzung der Kamera als passiver Erfassungssensor erheblich und verbessert die Stabilität und Robustheit des gesamten Erfassungssystems erheblich. Die „chemische Reaktion“, die durch die Kombination der beiden erzeugt wird, ermöglicht es, die Leistung des autonomen Fahrwahrnehmungssystems zu entwickeln und eine wahrhaft präzise Wahrnehmung zu erreichen.

Lidar + Kamerafusion (Datenquelle: KITTI-Datensatz)

Obwohl es viele Probleme gibt, die darauf warten, dass die Leute Durchbrüche auf dem Weg der Anwendung von Lidar- und Kamerafusion untersuchen, wie z. , und "die Genauigkeit der Merkmalsverfolgung" Wie man sie weiter verbessert" und so weiter.

Da jedoch selbstfahrende L3-Autos nacheinander auf dem Markt sind, mögen heute, da die Lidar-Strecke weiterhin Feuer fängt, nicht nur Autounternehmen, sondern auch erfahrene Lidar-HerstellerSurestar, die seit mehr als zehn Jahren intensiv in der Produktforschung und -entwicklung tätig sind, haben auch begonnen, sich intensiv mit der Integration von Lidar und Kameras auseinanderzusetzen. Ich glaube, dass es nicht lange dauert, bis die „perfekte Integration“ von LiDAR und Kamera erreicht ist Wirklichkeit werden. Lassen Sie uns einer neuen Zukunft näher kommen, in der autonomes Fahren ausgereift und beliebt ist. (www.isurestar.net)